Análisis de Diseños Unifactoriales Para Muestras Independientes

Transcript of Análisis de Diseños Unifactoriales Para Muestras Independientes

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

1/26

ANALISIS DE DISEOS UNIFACTORIALES PARA MUESTRAS

INDEPENDIENTES

Imaginemos que un experimentador quiere comparar los efectos de diferentes

tratamientos, tal como una serie de frmacos, sobre una variable dependiente tal

como la tasa cardaca. Para ello, ha escogido N sujetos de un modo completamente

al azar a partir una poblacin definida de antemano. A fin de comparar los efectos de

los frmacos, la muestra de N sujetos es dividida aleatoriamente en a grupos; esto se

realiza con el objeto de eliminar sesgos sistemticos en las caractersticas de losgrupos antes de comenzar el experimento. Finalmente, uno de los frmacos es

asignado aleatoriamente a cada grupo. La estructura de tratamiento en este caso es

unifactorial, en este caso el tipo de frmacos con a niveles de tratamiento, y el diseo

es completamente aleatorizado puesto que se ha realizado tanto una seleccin como

una asignacin aleatoria de los sujetos a los tratamientos.

El Modelo Lineal y Supuestos

Llamemosyij a la tasa cardaca del sujetoj tras la administracin del frmaco i.

Podemos pensar eny11, y12,...,y1n como una muestra aleatoria de tamao nde una

poblacin con media1y varianza 12, y eny21,y22, ...,y2ncomo una muestra aleatoria

de tamao n de una poblacin con media2y varianza 22, y asimismo para los i =

3,4,...,a frmacos. El parmetroi representa la media de tasa cardaca si uno

administrara el frmaco i a todos los sujetos de la poblacin. Se utilizar el supuesto

que 12 = 2

2 = ........ = a2 = 2 , es decir que la aplicacin de los tratamientos

afectar a la media de la respuesta en el tratamiento i, pero no a su varianza.

Un modelo lineal que describe la situacin anterior es el siguiente:

yij = i +eij para i = 1, 2, ....., a frmacos (3.1.1)

y j = 1, 2, ...n sujetos por tratamiento,

en donde se asume que:

eij NID(0, 2

) , (3.1.2)

57

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

2/26

Diseos Unifactoriales para muestras independientes

lo que significa que eij son independientes, y que estn distribuidos normalmente con

media igual a cero, y varianza igual a 2

.

Estimacin de Parmetros

El objetivo bsico de un buen anlisis estadstico es la estimacin de parmetros

que permita la realizacin de inferencias de inters. Los mtodos de inferencia

tpicamente incluyen el contraste de hiptesis y los intervalos de confianza. La

realizacin de inferencias en cualquier anlisis estadstico implica el tener un buen

estimador de la varianza de error de las unidades experimentales, es decir 2. En la

situacin anterior, la muestra correspondiente al tratamiento i, para i = 1, 2,...., a

proporciona un estimador de 2

cuando ni > 1. Es decir,

2

.2 2

1

( )

1

inij i

i i

j i

y yS

n

=

= =

(3.1.3)

es un estimador insesgado de 2en donde,

yi. =yijj=1

ni

ni

(3.1.4)

Decimos que i2esta basado en ni-1 grados de libertad, dado que la distribucin de

(n 1) i2

2es una distribucin chi cuadrado con ni-1 grados de libertad.

Una media ponderada de los a estimadores independientes de 2da el mejor

estimador de 2posible para esta situacin; cada estimador es ponderado por sus

correspondientes grados de libertad. As pues, el mejor estimador de 2es:

2 =

(nii=1

a

1) i2

(ni1)i=1

a

(3.1.5)

En el caso de que el diseo sea equilibrado, con el mismo nmero de sujetos por

tratamiento, la expresin anterior se reduce a:

58

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

3/26

2

2 2 1

a

i

iSa

== =

(3.1.6)

que representa la media de las todas las varianzas intragrupos. Es tambin cierto que

2

es un estimador de 2

basado enN - a grados de libertad, y que la distribucin

muestral de (N a)2

2es una distribucin chi-cuadrado conN - a grados de

libertad; es decir

(Na) 2

2 2 (Na). (3.1.7)

El mejor estimador de cada media de tratamiento es

i =yi parai = 1, 2, ...., a tratamientos

Bajo los supuestos dados en (3.1.2), la distribucin muestral de ies normal con

media iy varianza 2

ni . Es decir:

nN ii

2

,

para i = 1, 2, .....,a tratamientos. (3.1.8)

Tambin,

ti =i i

2

ni

t(Na)para i = 1, 2,....., a tratamientos (3.1.9)

Es decir, la distribucin muestral deti es la distribucin t de Student conN - a

grados de libertad. Adems, puede mostrarse tambin cmo 1, 2, .....,a y 2

son estadsticamente independientes (Hocking, 1995).Un intervalo de confianza de (1 - ) 100% para una combinacin lineal de

parmetros, cii y un conjunto de coeficientes c1, c2, ..., ca,viene dado por lasiguiente expresin:

22

/2, i

i i N a

cc t

n (3.1.10)

59

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

4/26

Diseos Unifactoriales para muestras independientes

Contrastes de Hiptesis

Los resultados anteriores pueden utilizarse para contrastar hiptesis sobre las

medias (i) individuales. Tambin pueden ser utilizados para contrastar hiptesis

sobre combinaciones lineales de las mismas, o para construir intervalos de confianza

sobre los valores de tales combinaciones lineales.

En el experimento anterior, el investigador quiere comparar a menudo los

efectos de diferentes tratamientos o, de forma equivalente, comparar sus medias

poblacionales. Consideremos en primer lugar los siguientes dos tipos de hiptesis,

H01 : i = i para algn par de tratamientos i, i

H02 : ci i =k p ara un conjunto de coeficientes c1,c2 ,.......,ca , y p ara una constantek

Tanto H01, como H02, pueden contrastarse mediante una prueba t para muestras

independientes:

22

( )

i i i i

e

i

c ct t N a

c

n

=

(3.1.11)

Puede utilizarse este resultado para realizar inferencias sobre cii . Dado queH01puede ser reformulada como i- i= 0, es un caso particular deH02 en donde ci=

1, ci= -1 y c = 0 para cualquier tratamiento distinto a i o i. El error tpico

estimado de cii viene dado por el denominador de la expresin anterior. A finde contrastarH02 , ha de realizarse el siguiente clculo:

22

i i

e N a

i

c kt t

c

n

=

(3.1.12)

Si tc >t / 2,N a , entoncesH02es rechazada al nivel de significatividad x 100%, en

donde t / 2,Na es el valor crtico correspondiente a una distribucin t conN - a

grados de libertad.

60

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

5/26

Una formulacin ms general de la hiptesis estadstica para realizar contrastes

simultneos de ms de un grado de libertad viene dada por:

H04

: C=k frente aa4

: C k

en donde

C:

c11 c12 . . c1a

c21 c22 . . c2 a

. . .

. . .

ck1 ck2 . . cka

.

:

1

2

3

4

5

y k :

k1

k2

k3

k4

k5

(3.1.13)

Aunque el procedimiento para realizar el contraste requiere algn conocimiento

de clculo de matrices, la mayora de los paquetes estadsticos actuales tales como

Statistical Package for the Social Sciences(SPSS), o Statistical Analysis System

(SAS) contienen mdulos sobre el Modelo Lineal General que permiten el uso de

estas tcnicas.

El Anlisis de Varianza

Consideremos la siguiente hiptesis, de inters frecuente en situaciones

experimentales:

H03 = 1 = 2 = ......... = a

Mientras que H01y H02implicaban contrastes de un solo grado de libertad, H03

implica la realizacin de varias comparaciones simultneas. La expresin anterior es

cierta si se cumple que la diferencia de medias para cualquier par de tratamientos es

cero, es decir: 1- 2= 0, 1- 3=0, 1- a = 0 ,....., 3-

a= 0. El contraste de H03,

que comprende varios grados de libertad, es tpicamente realizado mediante un

Anlisis de Varianza (ANOVA), que constituye un caso particular de (3.1.13). Esta

expresin surge porque se produce una particin de la varianza total en un

componente de tratamiento, y otro de error, y est basada en el hecho de que exista

independencia de la media y la varianza en muestras aleatorias de una poblacin

normal (Freund, 1992; Hogg & Craig, 1978).

Consideremos la siguiente expresin, que afirma que las desviaciones de una

serie de observaciones respecto de la media total comprende la suma de dos

componentes: a) la desviacin de una puntuacin respecto de la media de su propio

61

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

6/26

Diseos Unifactoriales para muestras independientes

grupo de tratamiento, y b) la desviacin de la media del grupo respecto de la media

total:

(yij y..)2j=1

n

i=1a

= (yij yi.)2

j=1

n

i=1a

+ n (yi. y..)2

i=1

a

(3.1.14)

El primer trmino es el numerador de la varianza de las puntuaciones respecto de

la media total, y por lo tanto ser denominado como la suma total de cuadrados. El

segundo trmino es la suma de cuadrados intragrupos, o la suma de los numeradores

de cada una de las varianzas intragrupos. El tercer trmino es nveces el numerador

de la varianza de las a medias de los tratamientos respecto de la media total

(asumiendo la existencia de un diseo equilibrado); es denominado como la suma de

cuadrados de tratamiento. Se puede verificar que,

(yij yi. )2

j=1

n

i=1

a

2 2con a(n-1)grados de libertad

(3.1.15)

n (yi. y.. )2

i=1

a

2

2con a - 1grados de libertad

y que ambas distribuciones son independientes (Hogg & Craig, 1978).

Dividiendo las sumas de cuadrados anteriores por sus correspondientes grados de

libertad, tenemos:

(yij yi. )2

j=1

n

i=1

a

a(n1)

2=

Se2

2a(n1)

2

a(n 1)(3.1.16)

2

. .. 2 2

1 1

2 2

( ) ( 1)

( 1)

a

i

i m a

n y y anS

a

=

=

, (3.1.17)

en donde Sm2

y Se2, representan las varianzas de las medias respecto de la media total,

y la varianza intragrupos.

Por definicin, el cociente entre dos variables aleatorias independientes con

distribucin 2y divididas previamente por sus grados de libertad, sigue una

62

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

7/26

distribucinF con los respectivos grados de libertad en el numerador y denominador

(Myers, 1995):

gl12

gl1gl2

2 gl2Fgl1,gl2

En el presente caso, el cociente entre las expresiones (3.1.17) y (3.1.16) seguir una

distribucinF con a - 1 grados de libertad en el numerador, y a (n - 1) grados de

libertad en el denominador,

nSm2

2

Se2 2

=nSm

2

Se2

Fa 1, a(n1) (3.1.18)

El numerador y denominador de la expresin anterior son llamados medias de

cuadrados de tratamiento y de error, respectivamente. Si la hiptesis nula es cierta,

ambas constituyen estimadores insesgados del mismo parmetro, 2, y el valor de la

raznFestar en torno a 1. Si la hiptesis nula es falsa, la media de cuadrados de

tratamiento estimar 2ms una constante o parmetro de no centralidad que es

funcin de las diferencias de medias poblacionales, como puede apreciarse en su

valor esperado descrito en la Tabla 3.1-1. As pues, los efectos experimentales

aumentarn el valor de la raznF, distancindolo de 1. En general, y en condiciones

de incertidumbre sobre si la hiptesis nula es o no cierta, el valor crtico de la tabla

permitir establecer un criterio de decisin sobre si rechazarla o o no, segn el nivel

de evidencia o significatividad elegido por el experimentador.

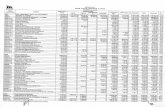

Tabla 3.1-1.

Medias cuadrticas esperadas para un diseo completamente aleatorizado con estructura de

tratamiento de un factor de efectos fijos.

____________________________________________________________________

Efecto g.l. MC F E(MC)

____________________________________________________________________

TRATAMIENTOa - 1 nSm2

nSm2

Se2

e2 +

n (ii=1

a

.)2

a 1

ERROR N - a Se

2

e

2

____________________________________________________________________

TOTAL N -1

63

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

8/26

Diseos Unifactoriales para muestras independientes

Efectos Fijos y Aleatorios

El modo de seleccin de los niveles de una variable o factor explicativo en un

diseo de investigacin es una caracterstica considerada relevante para identificar el

tipo de anlisis estadstico a realizar. Un factor se considera de efectos fijos si sus

niveles han sido seleccionados por un proceso no aleatorio, y si sus niveles consisten

en la poblacin completa de niveles. Un ejemplo sera dos niveles de dosis de un

frmaco, cuya administracin a los pacientes es una manipulacin sistemtica que es

reproducible en distintas replicaciones del experimento. Un factor es considerado

aleatorio si sus niveles consisten en una muestra aleatoria de una poblacin de

niveles posibles. Un ejemplo sera las diferencias entre escuelas en una prueba de

lenguaje. En un experimento podemos seleccionar una muestra al azar de escuelas

con el objeto de generalizar a una poblacin ms amplia, por ejemplo de todo el

estado. Como consecuencia, el parmetro de inters es el componente de varianza

asociado con la distribucin de todas las escuelas en la poblacin, m2

, que es objeto

de inferencia. La hiptesis estadstica puede ser expresada como:

H0 :m2 = 0 frente a H0 :m

2 > 0 (3.1.19)

Si esta es rechazada concluiremos que al menos dos de los niveles del factor aleatorio

generan resultados diferentes.

La diferencia entre el modelo de efectos fijos y aleatorio en el diseo

unifactorial completamente aleatorizado puede apreciarse en los valores esperados de

sus respectivas medias de cuadrados (ver Tablas 3.1-1 y 3.1-2). Como puede verse, el

mtodo de clculo de las medias cuadrticas no difiere del modelo de efectos fijos, y

en este caso de un diseo unifactorial completamente aleatorizado el procedimiento

de construccin de la razn F tambin es el mismo. A partir las medias de cuadrados

esperadas podemos derivar el siguiente estimador puntual de m2

:

m2 =

E[MCTRT] E[MCE]n

y Sm2 =

MCTRT MCEn

(3.1.20)

Mtodos para la construccin de intervalos de confianza sobre m2

, as como para la

estimacin de medidas derivadas del efecto experimental tal como la correlacin

64

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

9/26

intraclase pueden consultarse en Neter, Nachstheim, Wassermann & Kutner, 1996;

Montgomery, (1996) y Kuehl (1991).

Tabla 3.1-2.

Medias de cuadrados esperadas para un diseo totalmente al azar con estructura de

tratamiento de un factor de efectos aleatorios.

____________________________________________________________________

Efecto g.l. MC F E(MC)

____________________________________________________________________

TRATAMIENTO a - 1 nSm2

nSm2

Se2 e

2

+ nm2

ERROR N - a Se2

e

2

____________________________________________________________________

TOTAL N -1

Comparaciones Analticas entre Tratamientos

Es frecuente que un investigador tenga de antemano una serie de hiptesis

respecto de la diferencia de medias de los efectos de distintos tratamientos para las

que quiera encontrar una respuesta mediante el diseo de un experimento. Este tipo

de contrastes son denominados a priori, oplanificados. Es diferente la situacin en

que el investigador cree que existe un efecto indeterminado del tratamiento sobre la

variable dependiente, y se disea el experimento para evaluar esta creencia. Si se

rechaza la hiptesis nula de igualdad de medias en una prueba F, entonces el

investigador sabe que al menos uno de los contrastes entre los tratamientos no es

igual a cero. A partir de ese momento, el inters se centra en determinar cul o

cules de estas comparaciones es significativa. Estas comparaciones son

denominadas como no planificadas, ya que implican el anlisis exploratorio de

relaciones no anticipadas. El inters por realizarlas es sugerido a menudo tras la

apreciacin de los resultados de un experimento. Estas comparaciones a posteriori, o

post-hoc, tienen muchas veces una importancia crtica en el desarrollo de un campo

de investigacin, ya que conducen al desarrollo de nuevas hiptesis.

65

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

10/26

El Aumento acumulativo del Error Tipo I

El problema resultante de la realizacin de una serie de comparaciones analticas

en un conjunto de datos radica en que la probabilidad de error cuando la hiptesis

nula es cierta aumenta proporcionalmente con el nmero de comparaciones

realizadas. Cuando un experimento implica slo una comparacin, la probabilidad

de cometer un Error Tipo I corresponde al nivel de significatividad, , y la

probabilidad de no cometerlo es por lo tanto (1 - ). Cuando el experimento implica

C comparaciones independientes con el mismo nivel de significatividad , la

probabilidad de no cometer ningn error viene dada por el producto de sus

respectivas probabilidades, segn la regla de multiplicacin para sucesos

independientes:

(1 )(1 )......(1 )C trminos

= (1 )C

(3.1.21)

El trmino (1 - )Ces la probabilidad de no cometer un error tipo I en C

comparaciones independientes. La probabilidad de cometer uno o ms errores tipo I

es, por tanto,

1 - (1 - )C.

Al aumentar el nmero de comparaciones independientes, aumenta tambin la

probabilidad de rechazar alguna hiptesis nula que sea cierta. Por ejemplo, si =

0.05, y el investigador realiza tres, cinco o diez comparaciones, esta probabilidad es,

respectivamente:

3 5 101 (1 0.05) 0.14 1 (1 0.05) 0.23 1 (1 0.05) 0.40 = = =

Una estrategia alternativa es la de controlar el Error Tipo I a un nivel para el

conjunto de inferencias simultneas realizadas. Podemos distinguir entre C, o la

probabilidad de cometer un error Tipo I en una nica comparacin, y F, o la

probabilidad de cometer al menos un error Tipo I en una familia o conjunto de

comparaciones (Tukey, 1953).

Cuando un experimentador est realizando un anlisis detallado y exhaustivo, y

pretende dar respuestas a muchas preguntas no anticipadas, es recomendable el

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

11/26

controlar el nivel F = 0.05. Los mtodos que se exponen a continuacin constituyen

formas de llevar a cabo esta correccin aplicables a situaciones distintas. Aunque

tanto las comparaciones planificadas como las a posteriori conllevan un aumento del

nivel de error experimental (F), son por lo comn tratadas de forma diferente (Kirk,

1995; Keppel, 1992).

Comparaciones a Priori

Los mtodos de contrastes generales de combinaciones lineales son utilizados

frecuentemente en este caso sin ningn tipo de correccin, especialmente cuando el

nmero de comparaciones es igual o menor al de grados de libertad del factor de

tratamiento (Keppel, 1982), y cuando tales contrastes sean ortogonales (Kirk, 1995).

No es necesario en este caso realizar un ANOVA o prueba F antes de los contrastes

individuales. Este procedimiento responde a una pregunta general: Hay diferencias

entre las medias de tratamientos? Sin embargo, el investigador puede estar

interesado en un conjunto de preguntas especficas, y contrastarlas directamente. As

pues, concluiramos que ci i 0 cuando

22

/2,

1

ai

i i e

i i

cc t S

n

=

> (3.1.22)

En dondeNes el tamao muestral total, ni es el tamao muestral del grupo i, aes el

nmero de grupos experimentales, y son los grados de libertad del error. Un

intervalo de confianza de (1 - ) 100% para el contraste anterior viene dado por:

22

/2,

1

ai

i i e

i i

cc t S

n

=

(3.1.23)

Los intervalos de confianza permiten al investigador llegar al mismo tipo de decisin

que la obtenida mediante un contraste de hiptesis. Por ejemplo, si el valor del

parmetro hipotetizado para un contraste dado se encuentra fuera del intervalo de

confianza del 100(1 - )%, la hiptesis nula puede rechazarse al nivel de

significacin . El tamao del intervalo proporciona informacin sobre los margenes

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

12/26

de error de la estimacin. Por estos motivos, en psicologa se est utilizando cada

vez ms este tipo de inferencia.

El mtodo de Bonferroni. Este procedimiento es recomendado cuando el

conjunto de comparaciones planificadas no son ortogonales (Kirk, 1995), o cuando se

desean realizar tras una prueba F que no ha resultado significativa (Milliken &

Johnson, 1984). Supngase que se quiere realizar c comparaciones de este tipo. Se

concluira que una comparacin es significativa, y por tanto 0i ic , si

22

, /2, ,

1

a

ii i BON c e

i i

cc t S

n

=

> (3.1.24)

Estos ccontrastes realizados a un nivel de error por comparacin /c darn un nivel

global de error experimental igual o menor que F. Los valores crticos de /2, ,ct

vienen dados en las tablas elaboradas por Dunn (1961) para valores seleccionados de

, cy , los grados del libertad del error. Los intervalos de confianza son obtenidos

de forma anloga. Si calculramos los intervalos de confianza para los ccontrastes

entonces en el (1-)100 % de las replicaciones del experimento el conjunto completode intervalos contendra los valores reales de los parmetros.

Comparaciones a Posteriori

En el anlisis exploratorio de un conjunto de datos, existe una gran cantidad de

hiptesis contrastables de un grado de libertad. Por poner ejemplos de experimentos

con 3, 4, 5 y 10 niveles de tratamiento, el nmero pares posibles entre sus medias es

3, 6, 10, y 45 respectivamente. El nmero de contrastes de otras posibles

combinaciones lineales es todava ms amplio. Muchos procedimientos han sido

propuestos para tratar el problema del aumento del nivel de error experimental en

comparaciones a posteriori. La lgica de estas tcnicas es bastante clara y anloga a

la solucin de Bonferroni: si reducimos el tamao de la regin de rechazo en cada

comparacin, C, cometeremos un nmero menor de errores Tipo I y se reducir el

nivel de error experimental global, F. . De hecho, Games (1971, 1978b) ha mostrado

cmo los distintos procedimientos implican el mismo estadstico subyacente y

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

13/26

difieren solamente en la forma en que se implementa esta reduccin en el nivel de

error por comparacin. La cantidad exacta de ajuste depende de varios factores, tales

como nuestro criterio subjetivo sobre la gravedad del Error Tipo I, as como del

nmero total de comparaciones exploradas.

El mtodo de Scheff. Es una tcnica que permite al investigador mantener F

constante, independientemente del nmero de comparaciones realizadas (Scheff,

1953). Se puede utilizar cuando tales comparaciones se realizan tras la inspeccin de

los resultados, que sugieren efectos no anticipados. No requiere tablas especiales

puesto que est basado en los valores del estadsticoF. Se rechazar la hiptesis nula

Ho : ci i = 0 si

22

, 1,

1

( 1)F

ai

i i a e

i i

cc y a F S

n

=

> (3.1.25)

Es conveniente anotar que el mtodo de Scheff solamente resultar en algn

contraste significativo en el caso de que se rechace la hiptesis de igualdad de medias

en la pruebaF. El procedimiento puede utilizarse tambin para establecer un

conjunto de intervalos de confianza para contrastes C1, C2,...., Cp mediante la

siguiente expresin aplicada a cada uno de ellos:

22

, 1,

1

( 1)F

ai

i i a e

i i

cc a F S

n

=

(3.1.26)

El mtodo de Tukey. Hay situaciones en las que un investigador puede estar

interesado en evaluar todas las diferencias posibles entre pares de medias. El nmero

total de comparaciones en este caso viene dado por la siguiente frmula:a(a1)

2

Este caso ocurre frecuentemente en investigacin aplicada, por ejemplo al comparar

la efectividad de distintos manuales de una asignatura sobre el rendimiento

acadmico de los estudiantes. En muchos casos, no hay razones obvias para formular

comparaciones complejas entre grupos de condiciones experimentales. La

investigacin con motivacin terica, en cambio, produce diseos experimentales

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

14/26

que generan un nmero limitado de contrastes a priori. Estos generalmente no

incluyen todas las comparaciones posibles entre medias sino un subconjunto de ellas

posiblemente combinadas con un par de contrastes ms complejos.

En el caso de que se pretenda realizar todas las comparaciones entre las medias,

la prueba de Scheff no es recomendable ya que tiene muy baja potencia estadstica.

La tcnica usualmente aconsejada en estos casos es la de Tukey (Kirk, 1995; Keppel,

1992; Neter, Kutner, Nachtsheim & Wasserman, 1996). Segn el metodo de Tukey

(Tukey, 1953), concluiremos la existencia de diferencias entre un par de medias

dado,

i i , cuando

2

( , , ) e

i i

Sy y q a

n > (3.1.27)

La distribucin del estadstico q, al igual que la del estadstico t, fue derivada

por William Gosset. Su clculo viene dado por la expresin

2

i i

e

yq

Sn

=(3.1.28)

Una hiptesis de dos colas es rechazada si el valor absoluto de q es igual o excede el

valor crtico ( , , )q a v obtenido mediante tablas (Kirk, 1995). El valor crtico al

comparar pares de medias en la mtrica original ser siempre menor si se utiliza la

tcnica de Tukey en comparacin del correspondiente valor si se utiliza la tcnica de

Scheff. As como Bonferroni y Scheff pueden ser utilizados en diseos no

equilibrados, la tcnica de Tukey requiere un nmero igual de observaciones por

tratamiento. Una generalizacin para el caso de muestras con tamao desigual ha

sido desarrollada por Spjtvoll y Stoline (1973). Segn sus resultados, se debera

concluir que i i , cuando

( , , )min( , )

ei i

i i

Sy y q a v

n n

> (3.1.29)

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

15/26

Las propiedades de este procedimiento deberan ser satisfactorias si el tamao de las

muestras no es muy desigual; en el caso de que s lo sean, el procedimiento es mucho

menos sensible que el mtodo de Scheff.

La prueba de Dunnett. El propsito de muchos experimentos es comparar las a

-1medias de tratamiento con un grupo de control. Dunnett (1955) desarroll un

procedimiento de comparaciones mltiples para estos fines, que efecta una

correccin del Error Tipo I menos restrictiva que en los mtodos de Tukey o Scheff,

al considerar el nmero menor de contrastes, a - 1, realizado en estos casos. En cada

uno de ellos, concluiremos que i control, cuando

2

2( , , )

e

i i DN

Sy y t a v

n > (3.1.30)

La tabla del estadstico tDNpresenta dos probabilidades: a) las relativas a las hiptesis

alternativas unidireccionales, o de una sola cola, y b) las probabilidades relativas a

hiptesis de dos colas.

Comparaciones cuando existe Heterogeneidad de Varianzas

El denominador del estadstico t utiliza un nico estimador de la varianza

agrupada bajo el supuesto de que sta es homognea para los distintos grupos. Si

esto no es cierto, su uso puede provocar un aumento del nivel de error Tipo I (Games

& Howell, 1976). El error Tipo I puede verse especialmente afectado cuando el

tamao de las muestras sea desigual, y las muestras ms pequeas sean obtenidas de

las poblaciones con varianzas mayores. Si el supuesto de igualdad de varianzas no

puede mantenerse, la varianza agrupada en el denominador del estadstico t puede

ser reemplazada por una combinacin lineal de varianzas de los grupos. Definiremos

el estadstico resultante,t* como:

t* =

cii=1

a

ici

2 i2

nii=1

a

=

c11 + c2 2 + .......+ca ac1

212

n1+

c222

2

n2+ .... +

ca2 a

2

n3

(3.1.31)

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

16/26

Los primeros intentos para determinar la distribucin muestral de t* fueron hechos

por Behrens (1929), y desarrollados por Fisher (1935). No existe una solucin exacta

para este problema. Un nmero de aproximaciones han sido propuestos por Cochran

(1964), Satterthwaite (1946), y Welch (1938, 1947). En general, hay bastante acuerdo

entre estas soluciones aproximadas (Lee & Gurland, 1975). Tablas para la

distribucin de t* han sido elaboradas por Aspin (1949), pero una buena

aproximacin a los valores crticos de t* puede obtenerse a partir de distribucin t de

Student con grados de libertad:

v =ci2

i2

nii=1

a

2

ci4 i

4 ni2(ni 1)[ ]

i=1

a

(3.1.32)

En este caso, concluiremos que ci i 0 cuando,

cii >t/ 2, vci2

nii=1

a

i2 , (3.1.33)

en donde v viene dado por la expresin (3.1.32). Un intervalo de confianza

aproximado del (1 - )100% puede obtenerse mediante la siguiente expresin:

ci

i t /2,vci

2

nii=1

a

i2 (3.1.34)

Wang (1971) inform que cuando el tamao de las muestras es mayor de cinco, la

aproximacin anterior de Welch (1938, 1947, 1949) controla el nivel de error Tipo I

en valores bastante cercanos a , el valor nominal, para un rango bastante amplio de

varianzas poblacionales.

Los resultados anteriores pueden ser utilizados con cualquiera de los mtodos de

comparaciones simultneas descritos en este tema, dado que stos emplean el mismo

estadstico t de Student subyacente, y sus diferencias se limitan en sus valores crticos

de significatividad estadstica respectivos. Estas correspondencias con la distribucin

tpueden apreciarse en la siguiente tabla:

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

17/26

Tabla 3.1-2

Correspondencia de Criterios Estadsticos Asociados con Diferentes Procedimientos

de Control del Error Tipo I.

__________________________________________________________________

Procedimiento Valor crtico de la distribucin t de Student

__________________________________________________________________

Bonferroni t / 2,v

Scheff1 (a 1)F,t1,v

Tukey2

q (,a,v)

2

Dunnett tDN(,a,v)

__________________________________________________________________

1Recurdese que F,1,v = (t / 2,v )

2.

2En el caso particular que a = 2, puede consultarse en la tabla como

q(,2, v) = 2 t( 2,v)

Cuando el supuesto de homogeneidad de varianzas es incumplido calculamos el valor

del estadstico t de forma diferente, t*en la expresin (3.1.31), as como sus grados

de libertad, v en (3.1.32). Sin embargo podemos seguir segn Myers (1995) los

mismos criterios de la tabla anterior para encontrar los valores crticos.

Sustituiremos as los grados de libertad exactos, en el caso de varianzas homogneas,

por los aproximados (redondeados al nmero entero ms cercano) en el caso de

varianzas heterogneas. Los resultados obtenidos con este procedimiento han sido

bastante satisfactorios en los casos que se han investigado (Brown & Forsythe, 1974;

Keselman, Games & Rogan, 1979; Kohr & Games, 1977; Tamhane, 1979).

Magnitud del Efecto y Potencia Estadstica

Uno de los objetivos de un estudio experimental es que tenga la suficiente

potencia estadstica que le permita detectar diferencias reales entre tratamientos que

estn presentes en la poblacin. En general, se puede disear experimentos con

-

7/24/2019 Anlisis de Diseos Unifactoriales Para Muestras Independientes

18/26

potencia estadstica utilizando muestras grandes, condiciones experimentales que

produzcan efectos pronunciados, o reduciendo la variabilidad aleatoria. Tambin

podemos aumentar la potencia estadstica seleccionando un diseo experimental ms

sensible, tal como un diseo intrasujetos, o un diseo de bloques al azar, o utilizando

procedimientos estadsticos especiales tales como el anlisis de covarianza. A

continuacin se comentar conceptos y tcnicas presentes en la literatura que nos

permitirn realizar una planificacin previa de un experimento, a fin de que ste sea

sensible en detectar efectos de inters.

Estimacin e Indices de Magnitud del Efecto

La prediccin es uno de los objetivos bsicos de la ciencia. En el estudio de un

comportamiento de inters sera deseable el contar con ndices que nos indiquen el

grado en que ste es afectado por una o ms variables independientes. Se suele

utilizar el nivel de significatividad de una prueba F como ndice. Sin embargo, el

nivel de probabilidad observado, o valor p, no es siempre apropiado. Por ejemplo,

imaginemos que comparamos una prueba F que ha resultado significativa con p

![TEMA 5 revisado 2 por Reales 4 - Google Sitessites.google.com/site/apuntesunedblog3/home/tema5disenos.pdf[TEMA 5] Diseños con más de dos grupos independientes 2 Índice 5.1.- Introducción](https://static.fdocuments.co/doc/165x107/5f8aac9e29e0f77d616f2e12/tema-5-revisado-2-por-reales-4-google-tema-5-diseos-con-ms-de-dos-grupos.jpg)