vision por computadora unidad uno.pdf

-

Upload

marrtin-nieblas -

Category

Documents

-

view

20 -

download

0

Transcript of vision por computadora unidad uno.pdf

CONCEPTOS BÁSICOS DE SISTEMAS DE VISIÓN

MAESTRÍA EN INGENIERÍA MECATRÓNICA

ALUMNO:

JESÚS MARTÍN NIEBLAS MANRÍQUEZ

ASIGNATURA:

VISIÓN POR COMPUTADORA

UNIDAD I – INTRODUCCIÓN A LOS SISTEMAS DE VISIÓN

FACILITADOR:

DR. MIGUEL ÁNGEL DE LA TORRE GÓMORA

06 DE SEPTIEMBRE DE 2015.

UNIVERSIDAD DE GUADALAJARA

CENTRO UNIVERSITARIO DE LOS VALLES

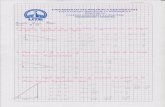

1. Dibuja la manera en que los rayos luminosos de la

escena llegan al plano de la imagen en el modelo de

cámara obscura de agujero de alfiler (pinhole). (Tip.

Figura 1.2 del libro de texto 2a edición).

Debido a que se tiene una superficie curva, su modo de procesar una imagen es

parecida a la del ojo humano, en esta imagen se observa una referencia en el

centro de la esfera, la cual sirve para determinar los vectores de luz y el ángulo

que se produce entre ellos.

2. Define con tus propias palabras que es el plano de la

imagen.

El plano de la imagen, es una ilustración invertida consecuencia de la propagación

rectilínea de la luz de un objeto que se refleja en un plato translúcido de una caja

oscura.

3. Define con tus propias palabras la reflexión y la

refracción en la interface entre dos medios

homogéneos.

Refracción y reflexión.

Es cuando la luz toca una superficie de separación de dos medios que poseen

cierta velocidad de luz diferente, una parte de la energía luminosa de transmite o

refracta y otra se refleja.

Refracción

La refracción es el cambio de dirección de un rayo de luz, esto se produce si dicho

rayo choca de manera oblicua o con un ángulo no recto contra una superficie con

un índice de refracción distinto.

El índice de refracción, n, es un número a dimensional que caracteriza a un medio

transparente, y de define por:

n=c/v

Donde c es la velocidad de la luz en el vacío, y la v es la velocidad de la luz en el

medio.

La refracción se origina por el cambio de velocidad de una onda de la propagación

de una onda.

Fue descubierta por experimentalmente por Willebrod Snell en 1621, y dice que

ángulos de incidencia y de refracción vienen dados por:

n1 senθ1 = n2 senθ2

Por ejemplo:

Un rayo de luz que se propaga en el aire entra en el agua con un ángulo de

incidencia de 45º. Si el índice de refracción del agua es 1.33, ¿Cuál es el ángulo

de refracción?

Solución:

Aplicando la formula n1 senθ1 = n2 senθ2 se puede determinar el ángulo de

refracción, el índice de refracción del aire se sabe que es igual a uno, teta uno es

igual a 45 grados y n2= 1.33, despejando θ2 se obtiene lo siguiente:

𝛉𝟐 = sin−1 n1 sin θ1

n2 = 𝛉𝟐 = sin−1 1 sin 45

1.33 = 32.1º

Reflexión

La reflexión al igual que la refracción es el cambio de dirección de un rayo de luz

cuando este choca contra una superficie de separación entre dos medios, pero en

este caso el rayo de luz regresa al medio inicial.

Ángulo critico

El ángulo crítico se define como aquel ángulo de incidencia para el cual, el ángulo

de refracción es 90º.

Si hago θ2 = 90º en la ley de Snell, podemos ver que el ángulo crítico viene dado

por: n1senθc=n2sen90º=n2*1, entonces se puede desglosar la siguiente fórmula:

𝐬𝐢𝐧 𝛉𝐜 =𝐧𝟐

𝐧𝟏

Por ejemplo:

Un vidrio determinado posee un índice de refracción n=1.50. ¿Cuál es el ángulo

crítico para la reflexión total de la luz que sale de este vidrio y entra en el aire, para

el cual, n=1?

Solución:

Despejando θc de la formula se obtiene:

𝛉𝐜 = sin−1 n2

n1 = 𝛉𝐜 = sin−1 1

1.5 = 41.8º

Como una ley de la reflexión se tiene que el ángulo de incidencia es igual al

ángulo de reflexión.

4. Investiga y explica con tus palabras e imágenes, el

funcionamiento de los diferentes tipos de retinas:

película, CCD, 3CCD y CMOS.

Sensor de imagen

Un sensor de imagen es como la película que utiliza la cámara analógica. Está

compuesto por millones de semiconductores de silicio, los cuales captan

elementos que componen la luz.

Los fotones desprenden electrones dentro del sensor de imagen, los cuales se

transforman en una serie de valores (datos digitales) creando un pixel. Por lo tanto

el sensor de imagen ira creando muchos pixeles hasta formar cada punto de la

imagen.

Clases de sensores:

Película

Consta de un material fotosensible, formado por haluros de plata. Estos se

descomponen al recibir radiación electromagnética formando un germen de plata

metálico o mejor dicho la imagen en negativo.

En estas la luz entra a la cámara fotográfica, atraviesa el diafragma, el lente

enfoca la imagen hacia la película y el obturador permite la entrada de la luz.

La imagen que llega a la película queda de manera invertida y el obturador se

cierra regulando la exposición a la luz de la misma.

Sensor CCD

El CCD es un sensor de procesamiento de imágenes que se usa mucho en la

actualidad, como ejemplo de en cámaras digitales y de video que se utilizan

actualmente.

El sensor CCD que por sus siglas significa charge-coupled devices (dispositivos

de cargas interconectadas) está construido en un semiconductor de silicio que

cuando recibe un fotón de luz, este libera electrones, y el número de electrones

liberados es proporcional a la intensidad de la luz.

El CCD es un sensor con muchas ventajas, una de ellas sería su relación señal-

ruido, la cual es muy buena y permite tener imágenes muy limpias, aunque

también tiene algunas limitaciones como:

Corriente oscura: es el salto de electrones por medio del calor, estos lo hacen

por medio de un fotón pero en caso de recibir bastante calor se puede producir

también.

Ruido fotonico: producido cuando hay escasa iluminación.

Rebosamiento: cuando una parte se llena de electrones, se distribuye su

contenido hacia los pixeles más cercanos.

Sensor CMOS

Por sus siglas significa complementary metal-oxide-semiconductor, también son

basados en semiconductores de silicio pero a diferencia de los sensores CCD,

estos utilizan su propia circuitería para cada pixel, lo que quiere decir que puedes

leer y seleccionar cada uno sin necesidad de moverlos.

Tienen muchas aplicaciones hoy en día como por ejemplo: en cámaras de

seguridad, webcams, foto-finish, entre otros, y son más baratos y rápidos.

Este ejemplo captura 1,000

columnas por segundo.

Los sensores CMOS tienen sus ventajas, tienen mayor rapidez de captura, menor

consumo, economía, disminuye el rebosamiento, y requiere menos circuitería

externa.

Como desventajas poseen menos superficie de luz por pixel, tienen menos calidad

en la imagen, son sensibles las interferencias y ruidos.

5. Realiza la lectura "The human eye", y explica e

ilustra (con tus palabras e imágenes) el

funcionamiento del ojo humano.

El ojo humano consta principalmente de cinco elementos principales, los cuales

son: el iris y la pupila: los cuales se encargan de controlar la luz que llega al globo

ocular. La cornea y el cristalino: estos dos elementos se encargan de controlar la

luz recibida por el iris y la pupila refractando los rayos luminosos para enviarlos a

la retina: este último tiene la función de crear la imagen que posteriormente es

procesada por el cerebro.

Para entender mejor se dará una breve explicación de cada una de las partes del

ojo humano:

Observando la imagen se muestra que la cornea es una capa delgada y curva que

está en la parte exterior del ojo. Debido a su gran curvatura es capaz de refractar

la luz que entra al ojo.

La pupila se encuentra en medio del iris, su función consiste en cerrarse o

expandirse (dilatarse) dependiendo de la cantidad de luz que esta reciba, ejemplo,

si se entra a una habitación oscura la pupila del ojo se dilatará puesto que

intentará captar la poca luz que se encuentra en el cuarto.

El iris tiene una apertura central que comunica las partes de la pupila, y su función

principal es controlar la cantidad de luz que recibe el ojo.

El cristalino tiene la capacidad de enfocar las imágenes percibidas a diferentes

distancias, esto lo logra debido al aumento o reducción de su curvatura y espesor.

Por último, la retina, que es una capa delgada que es encuentra en una de las

partes interiores del ojo. Esta poblada por cien millones bastones y 5 millones de

conos, a estos se les conoce como fotorreceptores. Los bastones funciones

principalmente en zonas donde hay poca luminosidad debido a que ellos procesan

las colares blanco y negro, mientras que los conos funcionan donde hay más luz,

debido a que procesan los colores de la naturaleza. Una vez procesado todo, la

retina manda la imagen al nervio ocular, el cual la manda al cerebro para ser

procesada.

Referencias

Forsyth, D. and Ponce, J. “Computer Vision: a modern approach”, Ed. PEARSON,

2011 (2a. ed)

Profesores del centro de documentación, procesos y medios de comunicación.

Recuperado el 04 de septiembre de 2015, de

https://www.serina.es/empresas/cede_muestra/219/TEMA%20MUESTRA.pdf

Manuel Rivas Pérez, tecnologías para adquisición de imágenes. Recuperado el 05

de septiembre de 2015, de

http://www.atc.us.es/descargas/Tecnologias_para_la_adquision_de_imagenes_%2

8Bloque2%29.pdf

Lluis Prat Viñas, sensores de luz y de imagen. Recuperado el 04 de septiembre de

2015.